MLKit人脸检测:精准追踪与去噪技巧

本文揭秘了如何巧妙结合 ML Kit 的对象检测与人脸检测能力,突破其原生人脸检测缺乏跨帧追踪的限制,构建“对象跟踪先行、人脸验证后置”的两级处理流水线——通过启用 ObjectDetector 的 trackingId 实现人体实例的稳定绑定,并在每个跟踪目标的 ROI 区域内独立运行人脸检测,从而精准锁定指定人物、准确获取头部姿态(如偏航角),彻底规避背景人员移动引发的误识别;同时自然支持实时人数统计与目标锁定功能,兼顾高性能、低延迟与端侧部署优势,为移动端智能视频分析提供了轻量可靠的技术路径。

本文介绍如何通过融合 ML Kit 的对象检测与人脸检测能力,实现对指定人物的稳定追踪与头部姿态估计,有效避免背景人员运动导致的误识别,并支持实时人数粗略统计。

本文介绍如何通过融合 ML Kit 的对象检测与人脸检测能力,实现对指定人物的稳定追踪与头部姿态估计,有效避免背景人员运动导致的误识别,并支持实时人数粗略统计。

在使用 ML Kit 进行人脸检测(如 getHeadEulerAngleY() 获取头部偏航角)时,若视频中存在多人且无明确目标区分机制,系统默认会返回检测到的第一个(或置信度最高)人脸的姿态数据——这极易导致后台移动人员干扰主目标分析,尤其在头部旋转检测等精细任务中严重影响鲁棒性。

根本原因在于:ML Kit 原生 FaceDetector 不提供跨帧人脸 ID、轨迹跟踪或优先级选择能力,其每次调用均为独立帧检测,无法天然区分“主讲人”与“背景路人”。

✅ 推荐解决方案:分层检测 + 轨迹绑定

采用「对象检测先行、人脸验证后置、ID 持续绑定」的两级流水线:

第一层:使用 ML Kit Object Detection(带跟踪)定位所有人体/上半身区域

启用 ObjectDetectorOptions 的 enableTracking = true,获取带唯一 trackingId 和稳定 boundingBox 的检测结果:val objectOptions = ObjectDetectorOptions.Builder() .setDetectorType(ObjectDetectorOptions.DETECTOR_TYPE_PERSON) .enableClassification() // 可选:辅助判断人体类别 .enableTracking() // 关键!启用跨帧 ID 跟踪 .build()第二层:对每个 tracked object 区域裁剪后,单独调用人脸检测器

仅在该 ROI(Region of Interest)内运行 FaceDetector,避免全局搜索干扰:val roiBitmap = Bitmap.createBitmap( fullFrame, object.boundingBox.left.toInt(), object.boundingBox.top.toInt(), object.boundingBox.width().toInt(), object.boundingBox.height().toInt() ) val faceInput = InputImage.fromBitmap(roiBitmap, 0) faceDetector.process(faceInput) .addOnSuccessListener { faces -> if (faces.isNotEmpty()) { // ✅ 此人脸属于当前 trackingId 对应的目标对象 val headYaw = faces[0].headEulerAngleY ?: 0f updateRotationForTrackId(object.trackingId, headYaw) } }实现目标锁定与人数统计

- 人数统计:objectDetector 输出的 List

- 目标锁定:用户首次点击/框选某 trackingId 后,后续仅处理该 ID 对应的人脸姿态,彻底隔离背景干扰。

⚠️ 注意事项:

- Object Detection 的 PERSON 模型需 Android 6.0+ 且推荐使用 STREAM_MODE 以保障实时性;

- ROI 裁剪务必做坐标映射校验(如考虑预览尺寸缩放、镜像翻转);

- 避免高频创建 Bitmap —— 建议复用 BitmapFactory.Options 或使用 Allocation(RenderScript)提升性能;

- 若需更高精度人脸 ID,可引入轻量级 Re-ID 模型(如 TensorFlow Lite MobileNetV3 + 特征比对),但会增加复杂度。

总结:ML Kit 本身不提供“多目标人脸追踪”能力,但通过对象检测的 trackingId 作为桥梁,构建 ROI 级人脸检测闭环,即可在不依赖服务端、不牺牲实时性的前提下,实现稳定的目标人物头部姿态分析与背景抗干扰能力。

本篇关于《MLKit人脸检测:精准追踪与去噪技巧》的介绍就到此结束啦,但是学无止境,想要了解学习更多关于文章的相关知识,请关注golang学习网公众号!

PHP防范AI生成HTMLXSS漏洞全解析

PHP防范AI生成HTMLXSS漏洞全解析

- 上一篇

- PHP防范AI生成HTMLXSS漏洞全解析

- 下一篇

- 12306余票查询方法与刷新技巧

-

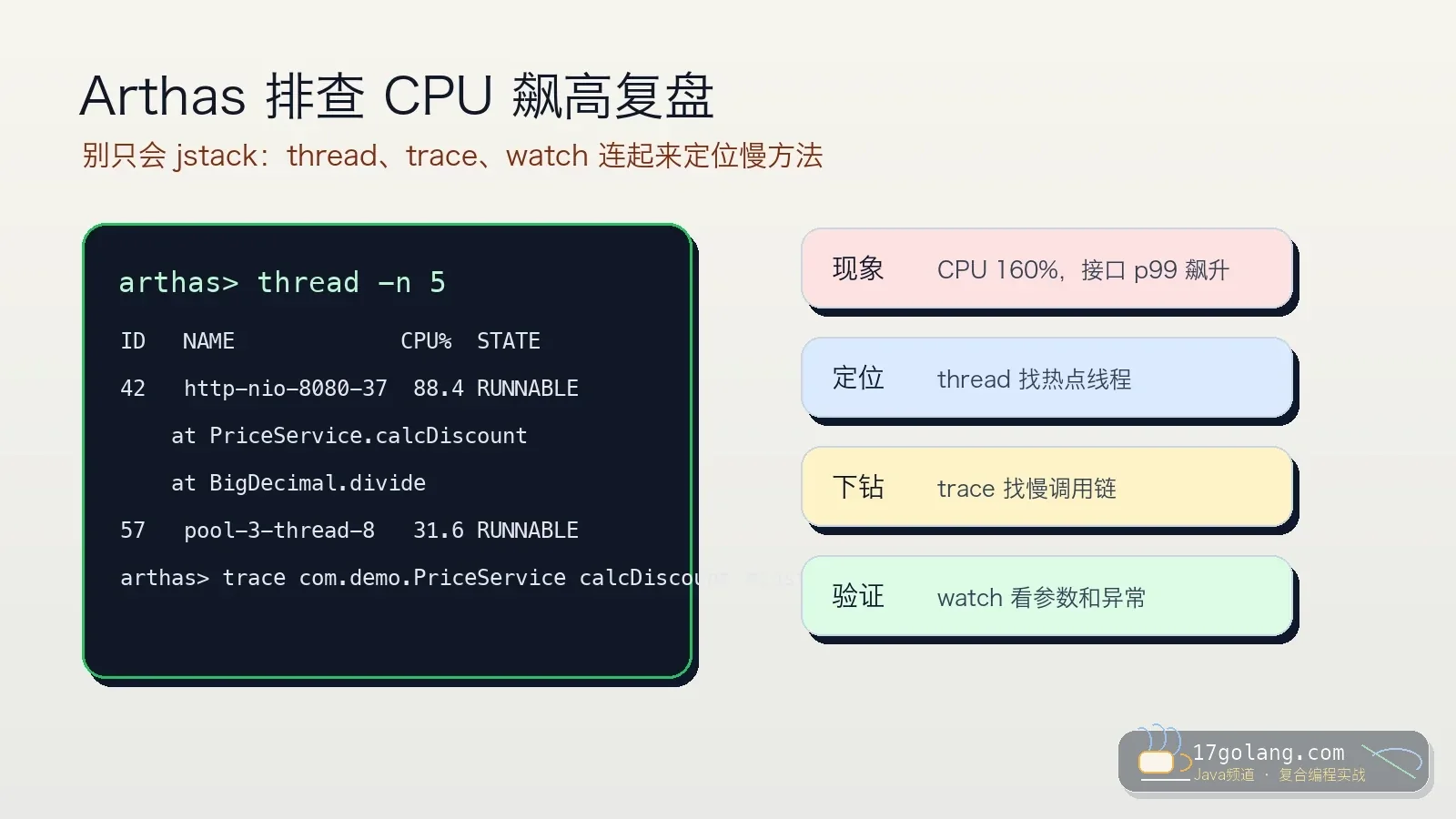

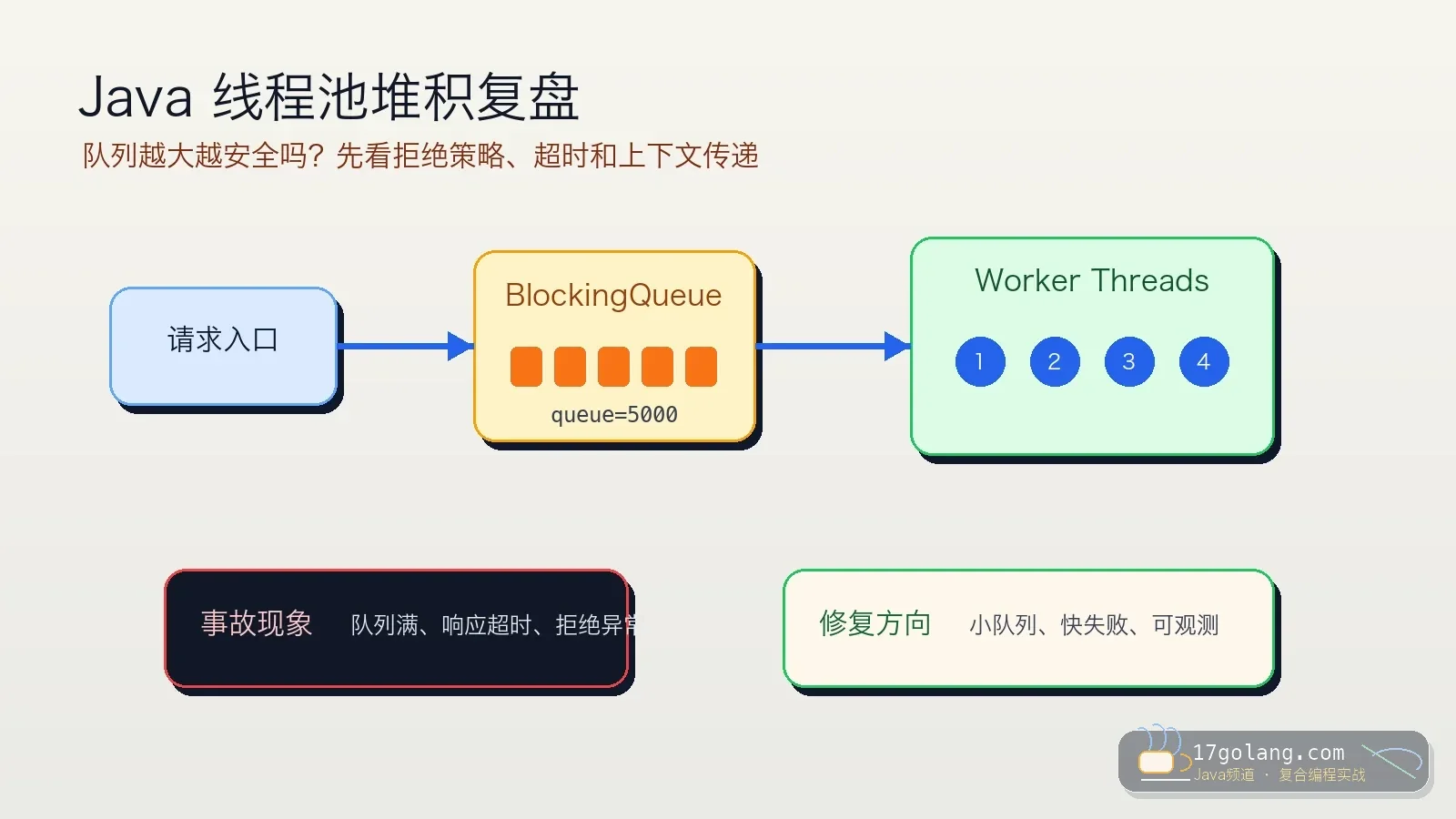

- 文章 · java教程 | 10小时前 | 线程池 · Spring Boot · 生产实践 · Java教程 · ThreadPoolExecutor · java 性能优化 线程池 spring boot threadpoolexecutor

- Java 线程池队列堆积复盘:别让无界队列把慢故障藏起来

- 326浏览 收藏

-

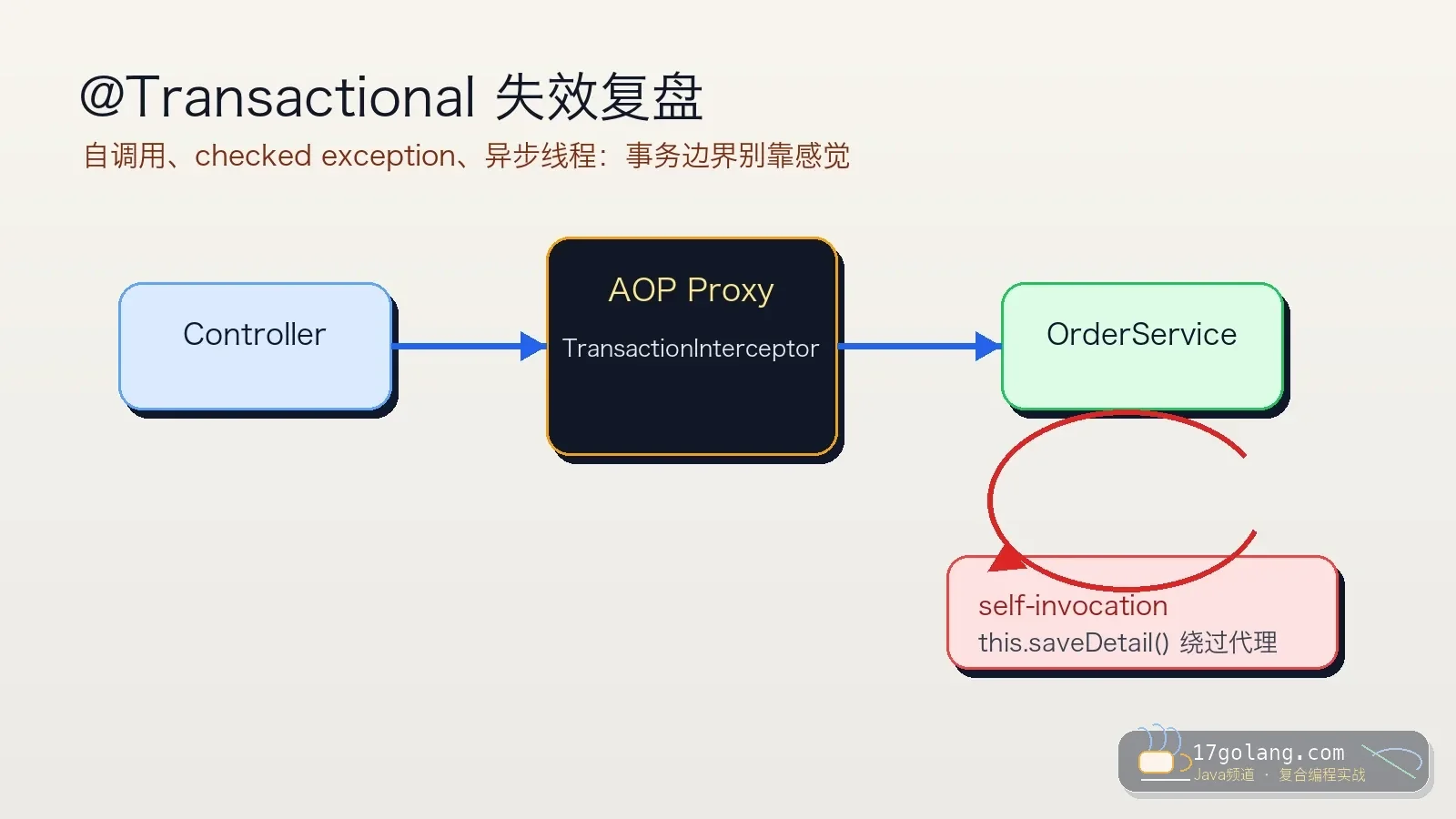

- 文章 · java教程 | 11小时前 | Spring Boot · 事务管理 · 生产实践 · Java教程 · Transactional · java 事务管理 spring boot 生产实践 Transactional

- @Transactional 失效复盘:自调用、异常回滚和异步线程别再踩坑

- 259浏览 收藏

-

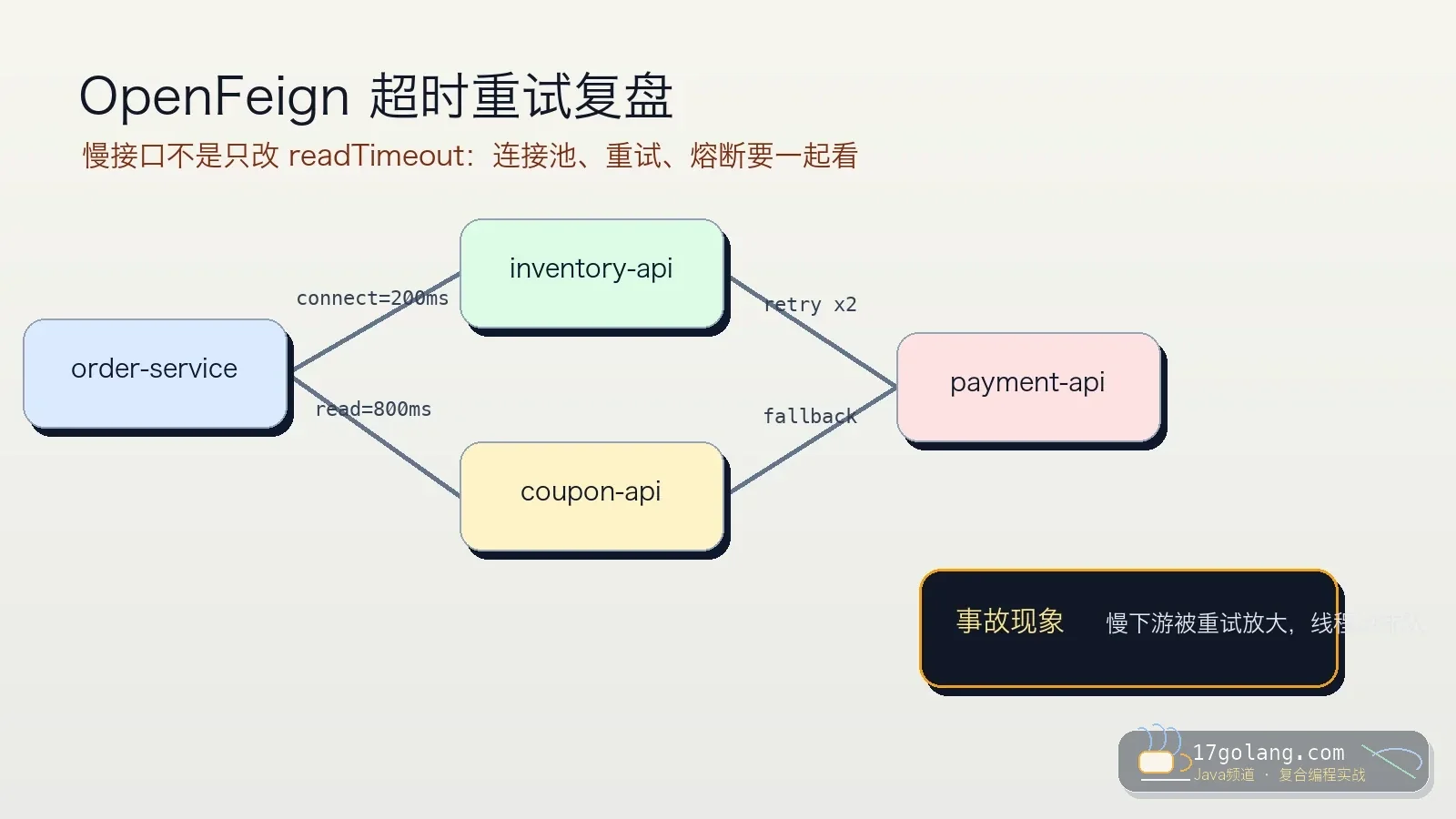

- 文章 · java教程 | 11小时前 | 微服务 · 生产实践 · Java教程 · Spring Cloud · OpenFeign · java 微服务 Spring Cloud 超时重试 OpenFeign

- OpenFeign 超时重试踩坑:别把慢下游重试成全链路雪崩

- 363浏览 收藏

-

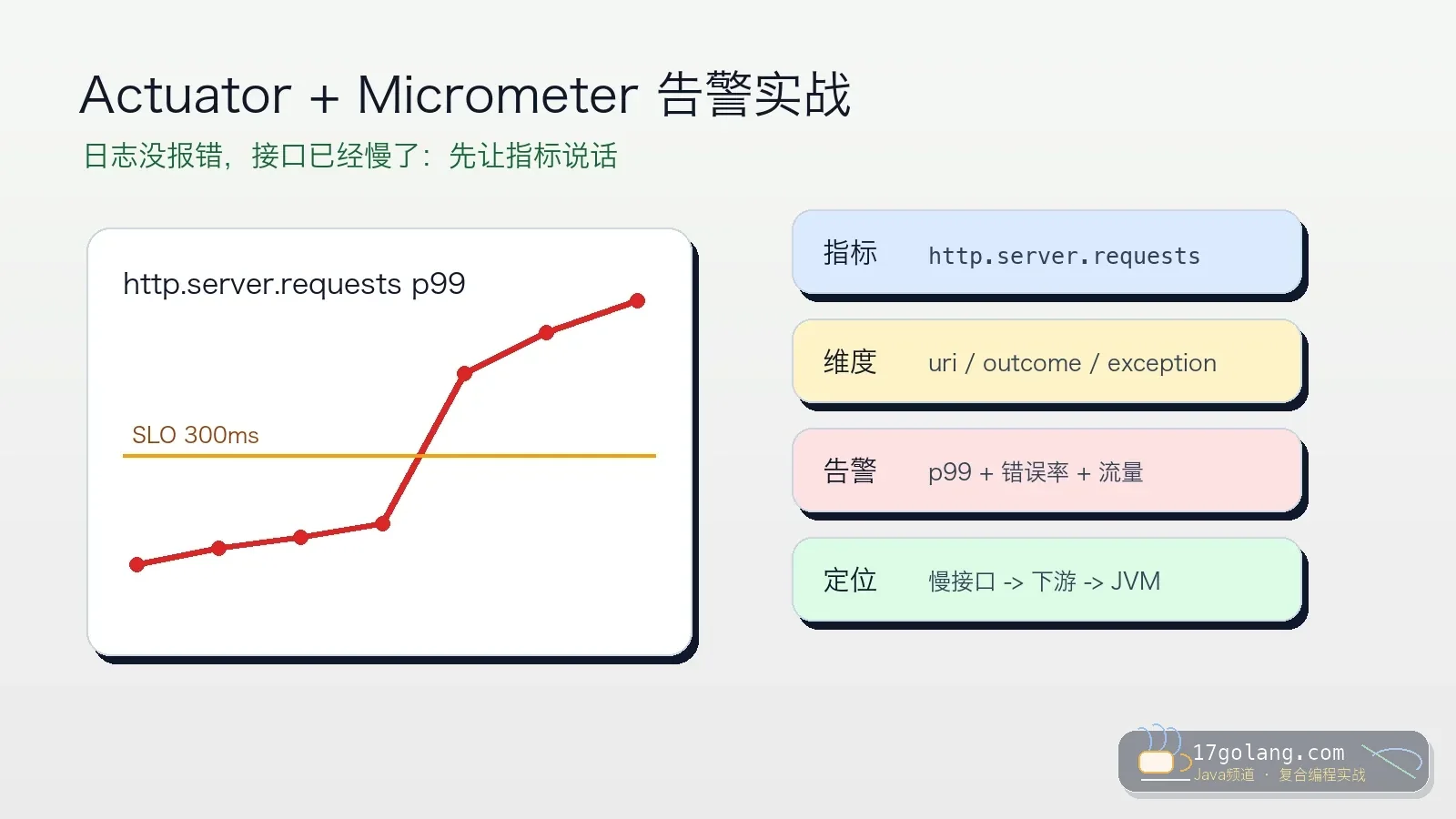

- 文章 · java教程 | 11小时前 | Spring Boot · 生产实践 · Java教程 · Micrometer · Actuator · java spring boot Micrometer 可观测性 actuator

- Spring Boot 指标告警实战:Actuator + Micrometer 让慢接口先暴露

- 240浏览 收藏

-

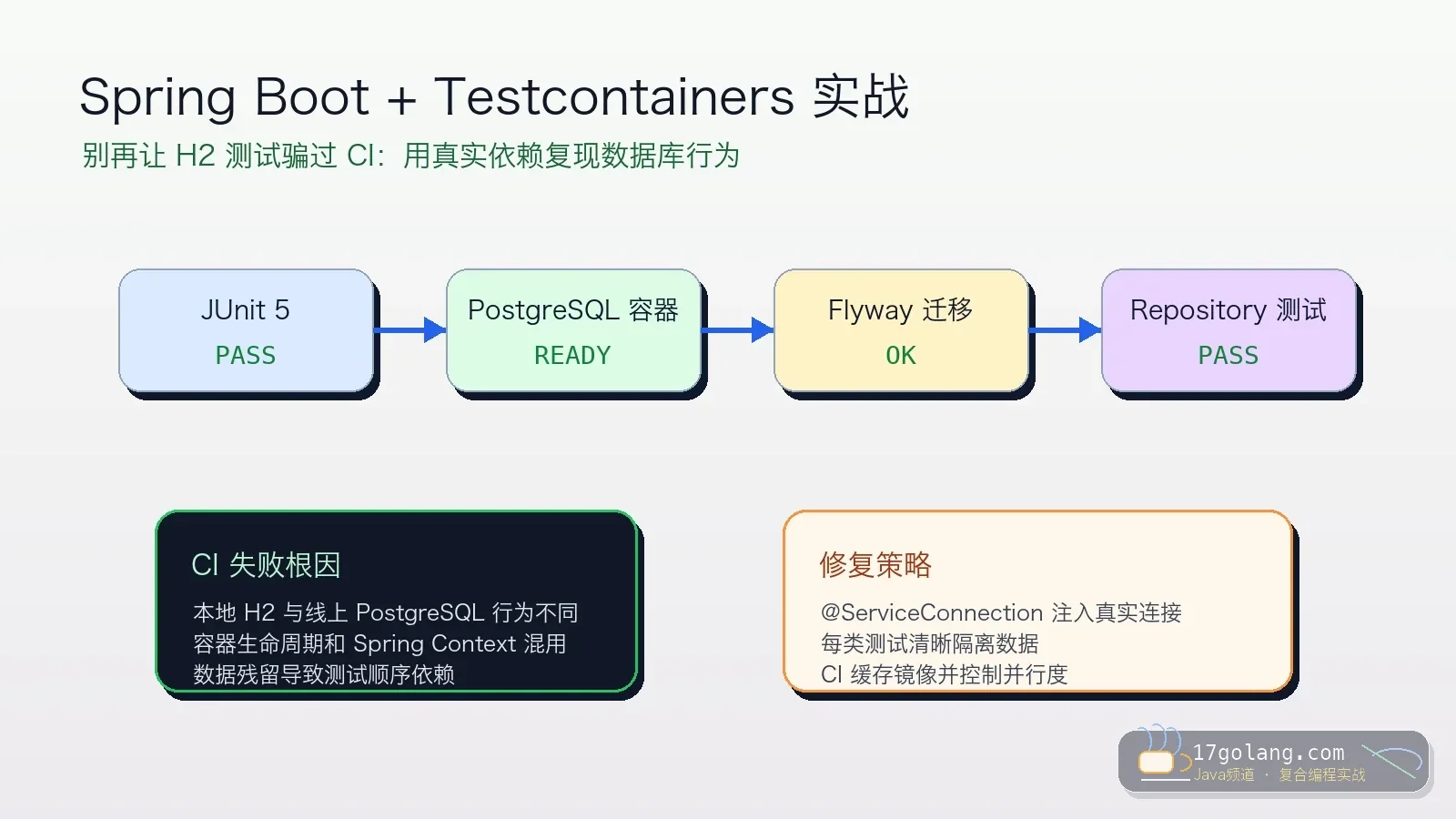

- 文章 · java教程 | 11小时前 | 工程化 · Spring Boot · junit · Java教程 · Testcontainers · java 集成测试 spring boot JUnit 5 Testcontainers

- Spring Boot 集成测试别再只靠 H2:Testcontainers 落地踩坑复盘

- 154浏览 收藏

-

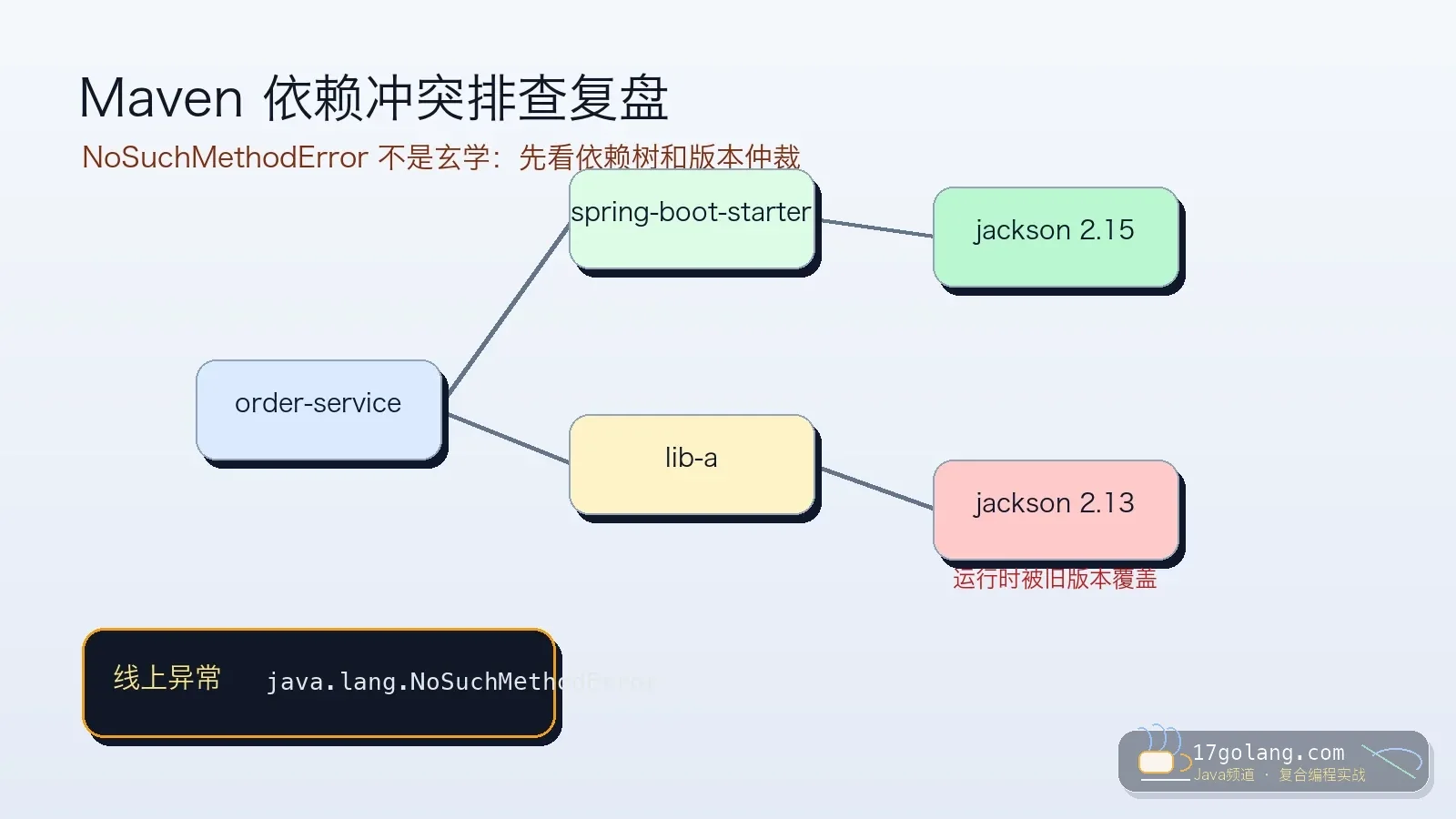

- 文章 · java教程 | 12小时前 | 依赖管理 · Spring Boot · maven · 生产实践 · Java教程 · java maven spring boot 依赖冲突 工程化

- Maven 依赖冲突排查:NoSuchMethodError 不是玄学,先看依赖树

- 135浏览 收藏

-

- 文章 · java教程 | 12小时前 | 数据库连接池 · Spring Boot · 生产实践 · Java教程 · HikariCP · java 性能优化 连接池 spring boot HikariCP

- HikariCP 连接池耗尽排查:别一上来就把 maximumPoolSize 调大

- 206浏览 收藏

-

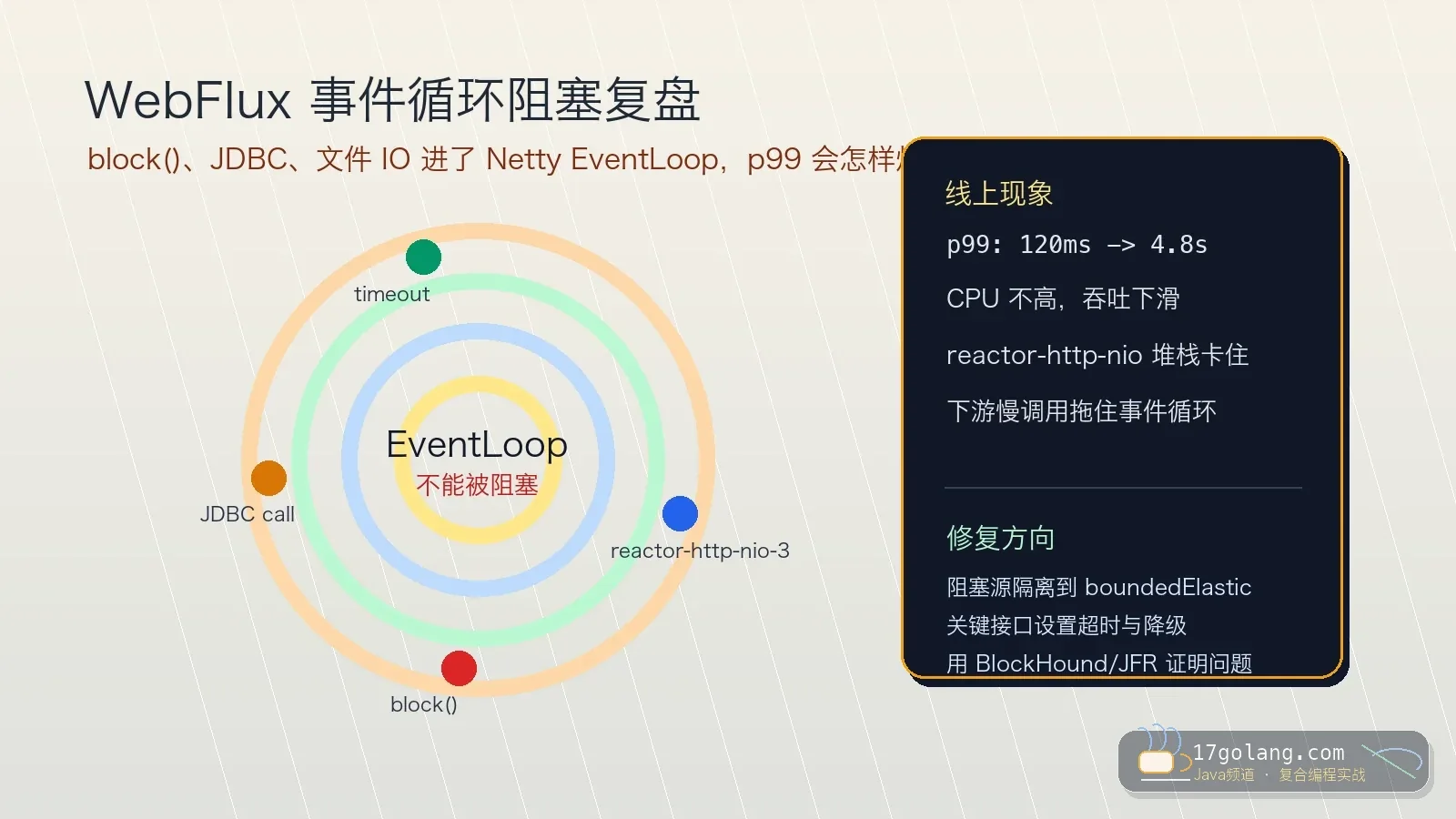

- 文章 · java教程 | 12小时前 | reactor · netty · 生产实践 · Java教程 · Spring WebFlux · java 性能优化 netty reactor Spring WebFlux

- WebFlux 里 block() 卡死事件循环:一次 p99 飙升的排查复盘

- 388浏览 收藏

-

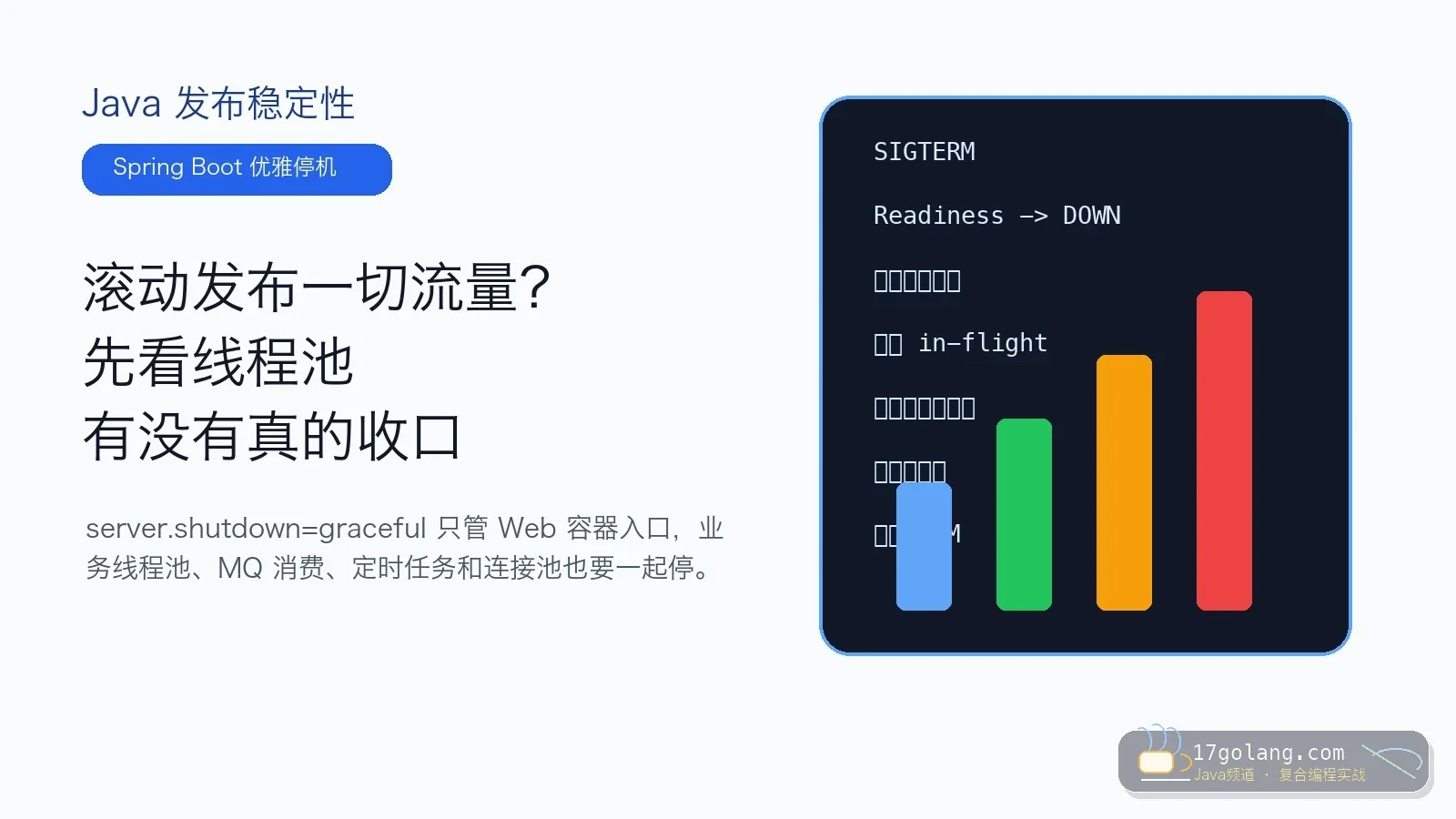

- 文章 · java教程 | 1天前 | 线程池 · Spring Boot · 生产实践 · Java教程 · 服务发布 · java 线程池 spring boot 优雅停机 生产实践

- Spring Boot 优雅停机实战:滚动发布别让线程池把请求丢在半路

- 390浏览 收藏

-

- 文章 · java教程 | 1天前 | Spring Boot · 生产实践 · Java教程 · Resilience4j · 微服务治理 · java 微服务 spring boot 熔断重试 Resilience4j

- Resilience4j 超时重试熔断实战:别把慢接口重试成雪崩

- 318浏览 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 485次学习

-

- ChatExcel酷表

- ChatExcel酷表是由北京大学团队打造的Excel聊天机器人,用自然语言操控表格,简化数据处理,告别繁琐操作,提升工作效率!适用于学生、上班族及政府人员。

- 6061次使用

-

- Any绘本

- 探索Any绘本(anypicturebook.com/zh),一款开源免费的AI绘本创作工具,基于Google Gemini与Flux AI模型,让您轻松创作个性化绘本。适用于家庭、教育、创作等多种场景,零门槛,高自由度,技术透明,本地可控。

- 6475次使用

-

- 可赞AI

- 可赞AI,AI驱动的办公可视化智能工具,助您轻松实现文本与可视化元素高效转化。无论是智能文档生成、多格式文本解析,还是一键生成专业图表、脑图、知识卡片,可赞AI都能让信息处理更清晰高效。覆盖数据汇报、会议纪要、内容营销等全场景,大幅提升办公效率,降低专业门槛,是您提升工作效率的得力助手。

- 6285次使用

-

- 星月写作

- 星月写作是国内首款聚焦中文网络小说创作的AI辅助工具,解决网文作者从构思到变现的全流程痛点。AI扫榜、专属模板、全链路适配,助力新人快速上手,资深作者效率倍增。

- 8254次使用

-

- MagicLight

- MagicLight.ai是全球首款叙事驱动型AI动画视频创作平台,专注于解决从故事想法到完整动画的全流程痛点。它通过自研AI模型,保障角色、风格、场景高度一致性,让零动画经验者也能高效产出专业级叙事内容。广泛适用于独立创作者、动画工作室、教育机构及企业营销,助您轻松实现创意落地与商业化。

- 6883次使用

-

- 提升Java功能开发效率的有力工具:微服务架构

- 2023-10-06 501浏览

-

- 掌握Java海康SDK二次开发的必备技巧

- 2023-10-01 501浏览

-

- 如何使用java实现桶排序算法

- 2023-10-03 501浏览

-

- Java开发实战经验:如何优化开发逻辑

- 2023-10-31 501浏览

-

- 如何使用Java中的Math.max()方法比较两个数的大小?

- 2023-11-18 501浏览